| HISTÓRIA DO COMPUTADOR - 31 - O futuro que vem aí Pesquisas têm aplicação em treinamento e na direção de veículos Vem crescendo rapidamente o interesse por interfaces inteligentes - em que a informação obtida com medidas visuais e/ou psico-fisiológicas do operador humano é usada diretamente para informar, interagir com, ou controlar sistemas baseados em computador. Esses dados incluem situações de alerta, atenção, intenção, prontidão e emoção. Em termos práticos, já existem sistemas em teste como o que percebe quando um motorista

está sonolento, e outros que verificam a capacidade do operador de responder rápida e precisamente a complexas combinações de circunstâncias. Curioso é o projeto Orpheus, o Cd-player afetivo, um sistema de fornecimento de música digital que toca músicas com base no estado emocional e nas preferências do usuário. Poderia, por exemplo, tocar música triste ao perceber que o usuário está triste, ou música para mudar esse estado de humor... Projetos Já pensaram num programa de conversa (chat) pela Internet, em realidade virtual, no qual os personagens rissem, chorassem e até ficassem ruborizados? Muitos internautas já conhecem os avatares, personagens que representam o operador humano num ambiente de realidade virtual. É como se o jogador escolhesse um personagem com suas características e agisse através dele nesse mundo virtual, para conversar com outros personagens, passear etc. Óculos de expressão captam expressões faciais, permitindo que elas sejam expressadas de forma livre e anônima

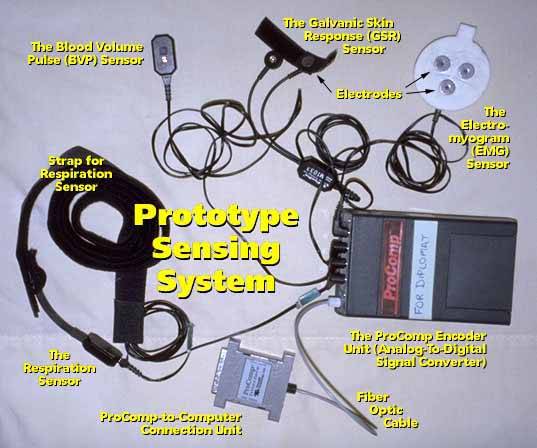

Máscaras faciais poderiam prover informações sobre movimentação muscular, um sensor de temperatura facial poderia fazer com que o rosto do avatar também ficasse ruborizado, durante a conversa com um interlocutor, por exemplo, tornando mais real a presença humana nesse mundo virtual. Caminho parecido é o seguido pelo projeto Bruzard, também do Mit Media Lab, enquanto outro trabalho da pesquisadora Jocelyn, Mood Ball, objetiva apresentar uma representação simplificada do estado do operador humano como em uma bola vermelha tridimensional. Por exemplo, o aumento da batida cardíaca aumentaria a rotação da bola, e uma redução na condutividade da pele mudaria a cor da bola para azul). A idéia seria fazer a pessoa reagir à representação de seu próprio estado emocional, e as bolas poderiam ser usadas numa conversação via computador para sinalizar o estado emocional dos parceiros. Outros pesquisadores estudaram o reconhecimento da emoção em um ator, utilizando bio-sensores (de eletromiograma, pressão sangüínea, condutividade da pele, temperatura e respiração para caracterizar oito estados emocionais diferentes: sem emoção, irritação, raiva, mágoa, amor platônico, amor romântico, alegria e veneração. Os sinais recolhidos pelos sensores permitiram criar uma classificação através do algoritmo de Projeção Fisher, determinando ainda que sinais estão relacionados com cada emoção. Aprender a detectar o sentimento de frustração, através de modelagem de sinais fisiológicos com algoritmos aprendidos pela máquina, é o escopo do projeto Frustration Detection. Já o estudo The Frustration Experiment é um experimento desenhado especificamente para deduzir uma resposta de frustração, com múltiplos canais de dados para algoritmos de reconhecimento de padrões.

Protótipos de equipamentos sensores biológicos (biosensores) Uma pesquisa de como os computadores podem ser desenhados para interagir com usuários humanos por natureza criaturas sociais e emocionais começa com o estudo das necessidades emocionais e sociais humanas, e isso também está sendo feito pelo MIT. Já o pesquisador Jonathan Klein, do grupo de Computação Afetiva, que lembra: "Hoje somos intimidados pela tecnologia, usada em sistemas computacionais que nos deixam frustrados. Mas, quando pudermos construir computadores com os quais possamos interagir em nível emocional, que tenham a habilidade de sentir e responder de acordo, possivelmente não nos sentiremos intimidados ou frustrados". |

Outras

pesquisas visam monitorar o estado de vigilância e a atenção de uma pessoa, o que permite por exemplo aperfeiçoar técnicas de treinamento interativo.

Para esses casos, os equipamentos básicos são os eletrodos para monitorar sinais cerebrais e câmaras com infravermelho para controlar os movimentos

oculares.

Outras

pesquisas visam monitorar o estado de vigilância e a atenção de uma pessoa, o que permite por exemplo aperfeiçoar técnicas de treinamento interativo.

Para esses casos, os equipamentos básicos são os eletrodos para monitorar sinais cerebrais e câmaras com infravermelho para controlar os movimentos

oculares. O projeto

O projeto